如果有價值 $100 萬美金的頂級專家任務(wù),AI 能完成其中多少?

答案是 48 萬美金,而只需要 100 美元的 Token 費(fèi)用。

這個數(shù)字怎么來的?Humanlaya Data Lab 聯(lián)合 北京通用人工智能研究院(BIGAI)、xbench、M-A-P,招募來自 Morgan Stanley、世達(dá)(Skadden)、協(xié)和醫(yī)院、國家電網(wǎng)、清華大學(xué)等頂級機(jī)構(gòu)或?qū)W府的 100+ 位資深專家,耗時 2000+ 小時,構(gòu)建了等價于人類專家工作價值百萬美元級評測基準(zhǔn) —— $OneMillion-Bench。

隨著 OpenClaw 的爆火,人們越來越關(guān)注 AI Agent 能夠?qū)嶋H替人類完成的任務(wù)。$OneMillion-Bench 的核心想法很直白:用“人類專家的時間與成本”給任務(wù)定價,再用“是否滿足專家要求”衡量模型交付質(zhì)量 —— 如果把 AI 當(dāng)成“數(shù)字白領(lǐng)專家”,總價值 100 萬美金的任務(wù),模型到底能賺多少錢?

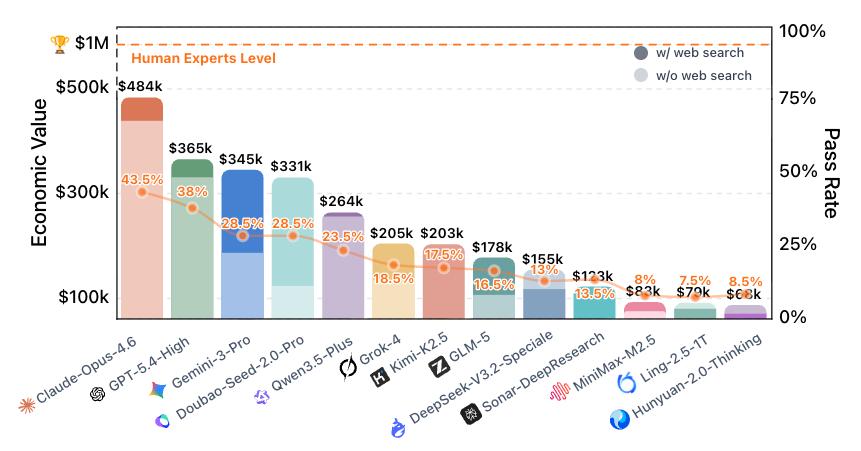

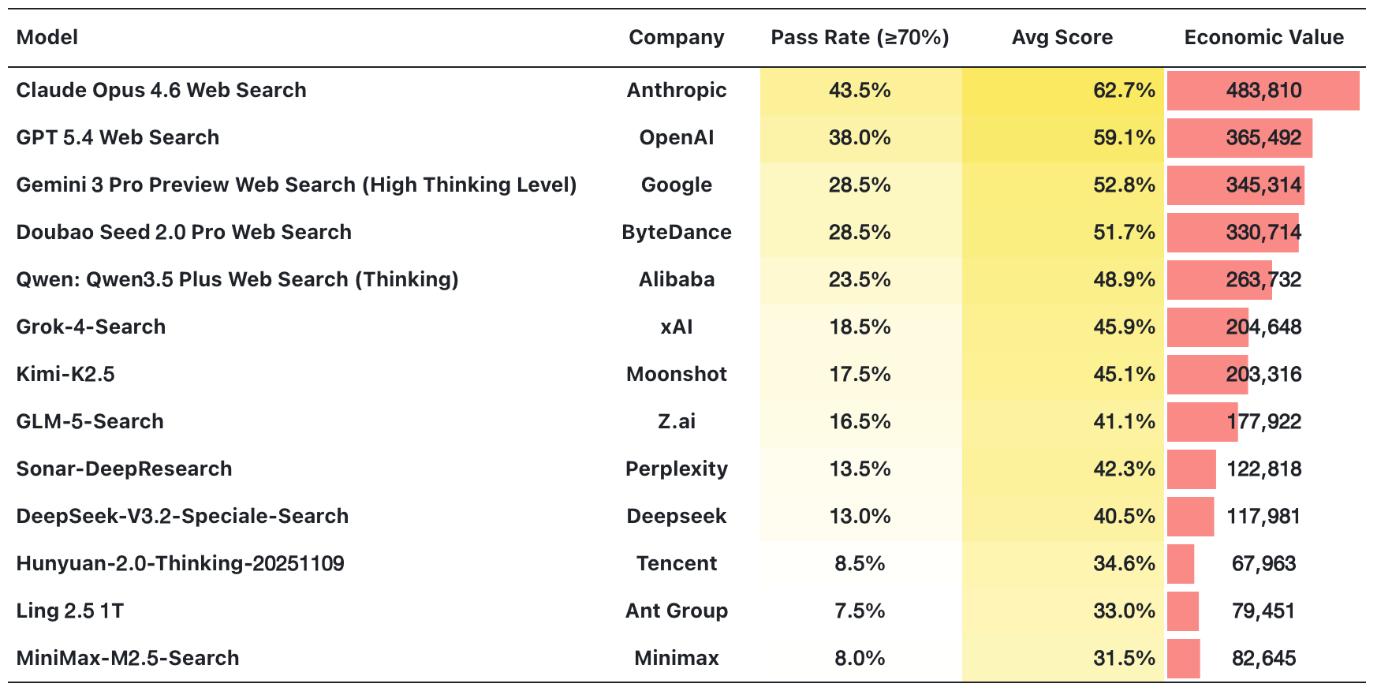

圖1:$OneMillion-Bench模型表現(xiàn)和其獲取的經(jīng)濟(jì)價值

01「Agent 能掙錢」成為日常,但行業(yè)更缺一把尺:可交付、可復(fù)核、可控

從 2025 Agent 元年開始,AI 逐漸從“答題機(jī)”推進(jìn)到“數(shù)字員工”,但業(yè)界現(xiàn)有評測集往往缺乏對實(shí)際經(jīng)濟(jì)價值的衡量,區(qū)分度不足、難以自動化且僅有英文語境,因此,$OneMillion-Bench 構(gòu)建了一套兼?zhèn)涓呓?jīng)濟(jì)價值 × 高區(qū)分度 × 可自動評測的基準(zhǔn)。

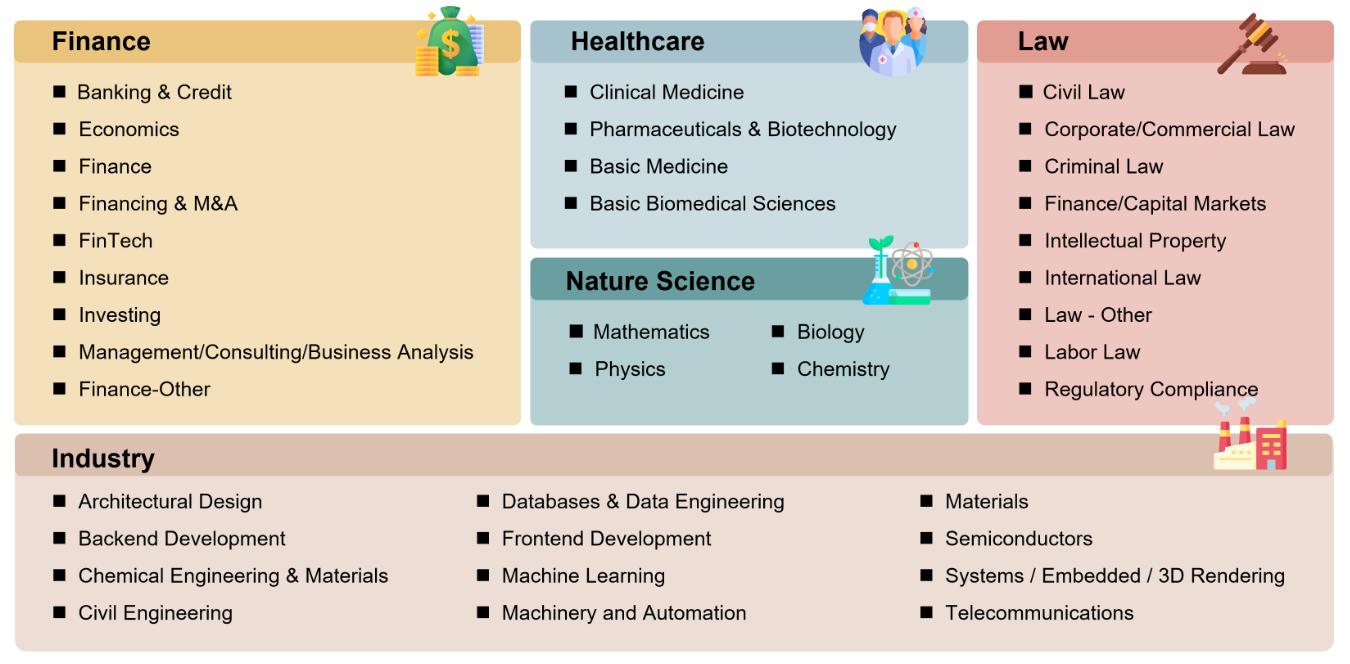

它包含 400道高難題目(200個英文題 + 200個中文題),覆蓋金融、法律、醫(yī)療、自然科學(xué)與工業(yè)五大領(lǐng)域的92個三級領(lǐng)域,與常見的考試題不同,每道題都是真實(shí)行業(yè)場景下的開放專家任務(wù),采用 Rubrics + LLM as Judge 評測。要求模型給出可落地的實(shí)操方案與判斷鏈路,在這些開放問題上,不僅回答“是什么”,更要說明“怎么做、按什么順序做、為什么這么做”。

圖2:$OneMillion-Bench 5 個領(lǐng)域,37 個二級和 92 個三級細(xì)分類別

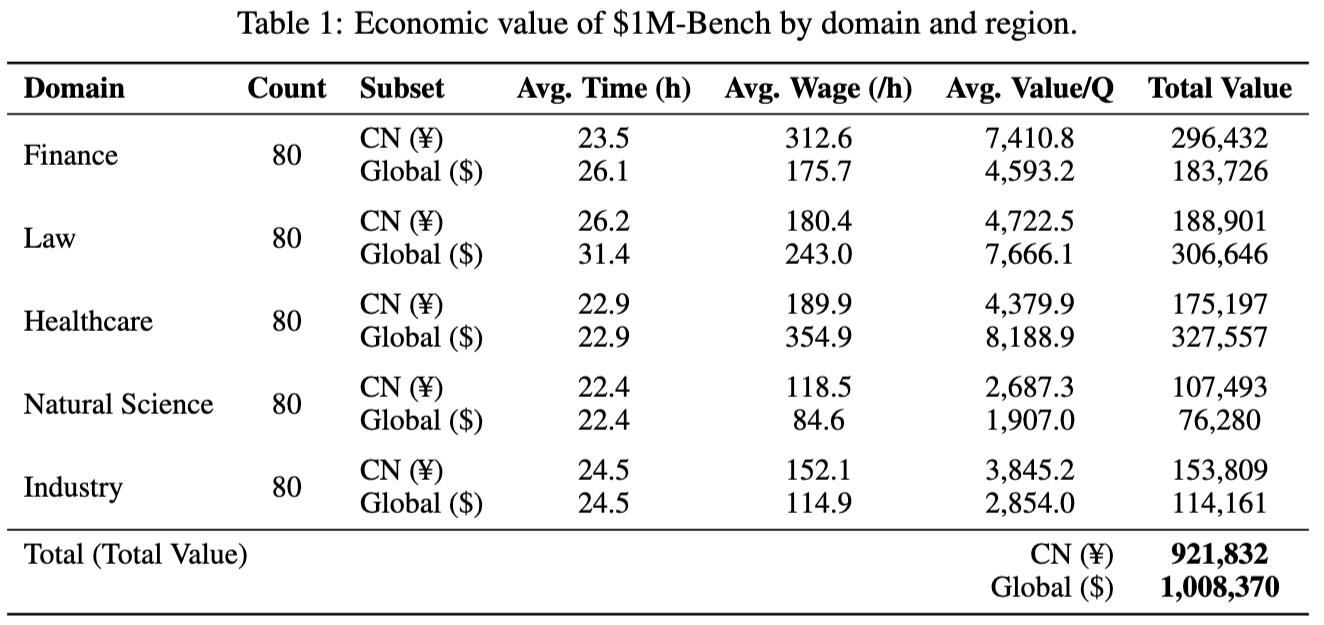

之所以是 $OneMillion,是因?yàn)檫@些任務(wù)真的很「貴」。

不同于傳統(tǒng)只評估模型準(zhǔn)確率的榜單,我們用“錢”來標(biāo)價每一道題的現(xiàn)實(shí)勞動價值 —— 任務(wù)經(jīng)濟(jì)價值 = 資深專家完成該任務(wù)的耗時 × 專家時薪。時薪錨定官方或行業(yè)權(quán)威數(shù)據(jù),如中國部分城市人社局、美國勞工統(tǒng)計局,任務(wù)的耗時來自多個領(lǐng)域?qū)<业墓餐u估。據(jù)此,把所有任務(wù)的經(jīng)濟(jì)價值加和計算后,超過了 100 萬美元。如果在現(xiàn)實(shí)世界里把這些工作交給資深專家團(tuán)隊完成,你需要支付的成本就是百萬美元量級。這樣一來,模型評測不再停留在分?jǐn)?shù)上,而是更直觀地回答:AI 現(xiàn)在到底能穩(wěn)定交付多少“可兌現(xiàn)價值”,以及距離真正上崗還差什么。

表1:$OneMillion-Bench 經(jīng)濟(jì)價值計算

02 四大關(guān)鍵設(shè)計:多樣化真實(shí)場景 + 高價值任務(wù) + 非對稱負(fù)分機(jī)制 + 高質(zhì)量與一致性

(1)經(jīng)濟(jì)價值出發(fā),構(gòu)建高真實(shí)性、高含金量專家任務(wù)

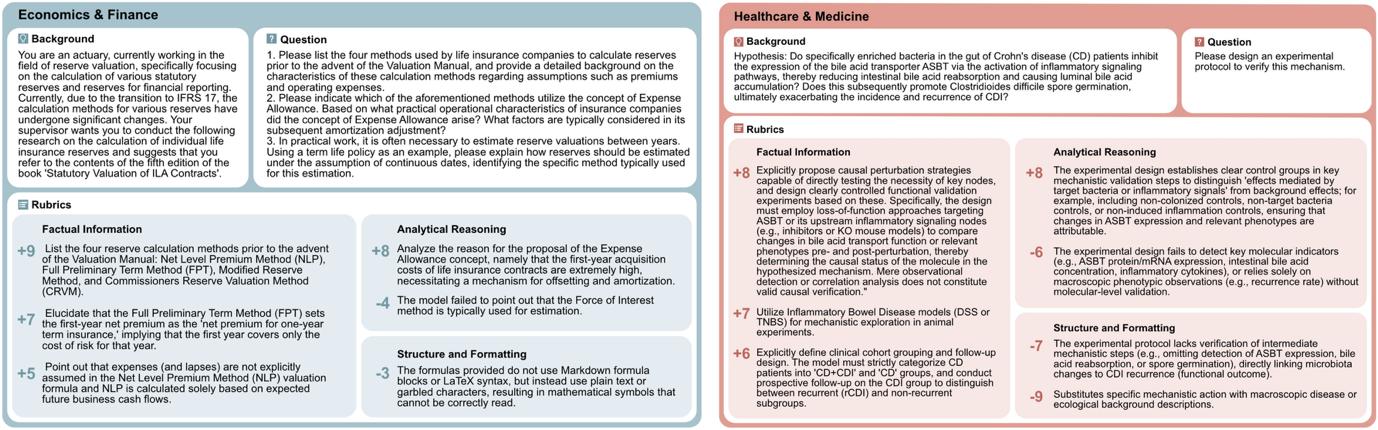

我們在評測中引入用貨幣度量的“經(jīng)濟(jì)價值”,核心是衡量模型在真實(shí)世界中能創(chuàng)造多少可交付的經(jīng)濟(jì)價值。開放式問題很難用單一標(biāo)準(zhǔn)答案衡量,我們邀請一線資深專家將真實(shí)工作流拆解為細(xì)顆粒度考點(diǎn):每道題設(shè)計 15–35 個考點(diǎn),累計 7000+ 考點(diǎn)。題目覆蓋 5–15 年經(jīng)驗(yàn)從業(yè)者在真實(shí)場景中常見的典型任務(wù),專家來自各類頭部機(jī)構(gòu),不只考知識點(diǎn),更考驗(yàn)特定場景下的專家級決策能力。

(2)引入“負(fù)分項(xiàng)”,防止 Reward Hacking

在開放式任務(wù)里,模型最容易走向“越說越多、看起來越專業(yè)”,蒙到考點(diǎn)就得分。為了避免虛高,我們加入行文邏輯和結(jié)構(gòu)、扣分項(xiàng)考點(diǎn)。模型如果只是堆砌內(nèi)容,沒有合理的邏輯展開,無法“撞到”高分。在考點(diǎn)分值設(shè)置上,我們采取 +10 ~ -20 的非對稱考點(diǎn)分值:正向能力給分更克制,明確或致命錯誤懲罰更重。這套結(jié)構(gòu)的效果更接近真實(shí)使用體感 —— 做對不一定加分很多,但做錯往往會帶來更大代價。

(3)覆蓋 92 個三級分類,含 CN + Global 兩大子集單獨(dú)區(qū)分中國大陸題目,場景足夠真實(shí)、豐富

我們將任務(wù)細(xì)化到覆蓋 92 個三級分類的真實(shí)崗位工作流;CN 是中文題目,Global 是英文題目,收集本地化、真實(shí)的題目,盡量還原真實(shí)的法規(guī)、流程與業(yè)務(wù)語境,從而更精準(zhǔn)刻畫不同模型在特定地域業(yè)務(wù)場景中的能力差異。

(4)一套“像生產(chǎn)線”的專家 Pipeline:讓高難 Rubrics 題可規(guī)模化、可質(zhì)控

為了確保數(shù)據(jù)場景真實(shí)、考點(diǎn)合理,團(tuán)隊在專家招募、選拔與培訓(xùn)上投入大量成本,專家平均整體通過率低于 5%,題目最終質(zhì)檢通過率 38.1%。數(shù)據(jù)生產(chǎn)采用 3-4 名專家協(xié)作的 Pipeline,包含對抗性評審與仲裁機(jī)制。在難度控制上,我們采取雙向截斷策略,剔除過易樣本,對于過難樣本二次復(fù)審,確保數(shù)據(jù)質(zhì)量。

圖3:$OneMillion-Bench題目示例

03 成績單解讀:SOTA 的分?jǐn)?shù)已經(jīng)合格,但距離交付仍有距離

目前最強(qiáng)模型通過率超過 40%,在 100 萬美元的任務(wù)上,大約可以產(chǎn)出 50 萬美元,而完成任務(wù)的 API 成本也就 100 美元左右!AI 不但已經(jīng)能“干活”,而且在極高難度、極高單價的專業(yè)任務(wù)里,已經(jīng)能交付相當(dāng)可觀的美元級別的價值。

表2:模型的平均通過率、平均分和可以產(chǎn)生的總經(jīng)濟(jì)價值

Insight 1:成績已經(jīng)合格,但離“可托付”還很遠(yuǎn)

如果只看平均分,頭部模型已經(jīng)進(jìn)入了合格區(qū)間(60%+),第二梯隊也普遍在 50% 以上,說明 AI 在專業(yè)任務(wù)上確實(shí)能覆蓋不少關(guān)鍵點(diǎn)。但在真實(shí)工作里,平均分其實(shí)不夠用,未達(dá)到一定質(zhì)量需要返工。因此,我們引入了更貼近落地的指標(biāo) —— 通過率(Pass Rate):單題得分達(dá)到 70% 及以上,本題才算“通過”。

基于這個定義,本榜單的 Economic Value(經(jīng)濟(jì)價值)也不是按平均分線性折算,而是嚴(yán)格按“可交付”口徑計算,只有通過的任務(wù)才計入“能賺到的錢”。平均分像“考試成績”,而通過率才是“上崗證”。

而從通過率的視角來看,即使是排名第一的 Claude Opus 4.6 Web Search,也驟降到 43.5%,即只有不到 45% 的任務(wù)可以通過驗(yàn)收,第二梯隊多在 25~30% 區(qū)間徘徊。換句話說,平均分看起來“能用”,但能在一半以上任務(wù)里穩(wěn)定達(dá)到可交付標(biāo)準(zhǔn)的模型,目前還不存在。

目前,AI 已經(jīng)能穩(wěn)定交付一部分題目、并且能賺到很可觀的價值,但榜單也清楚告訴我們另一半真相:距離可交付專業(yè)任務(wù)仍有相當(dāng)一段路程。

Insight 2:Web Search 是一把雙刃劍

Web Search 工具調(diào)用通常能顯著補(bǔ)齊事實(shí),尤其在經(jīng)濟(jì)金融領(lǐng)域的時效性問題,同樣適用于醫(yī)療、工業(yè)、法律中不斷迭代和演進(jìn)的規(guī)范和約束。

但它也會引入噪聲與“看似權(quán)威的錯誤來源”,從而出現(xiàn)波動甚至回退。下一階段競爭不只是“有沒有搜索”,而是“會不會搜索”以及搜索工具的效果如何:會不會選源、會不會交叉驗(yàn)證、會不會把證據(jù)鏈寫進(jìn)推理、會不會在噪聲下保持一致性。

Insight 3:復(fù)雜推理仍是通用瓶頸,方向正確但缺乏可執(zhí)行的細(xì)節(jié)

模型擅長寫一段看起來連貫的解釋,但一旦任務(wù)需要深層理解、多步演繹、或在巨大可能空間里探索,就仍會出現(xiàn)深度不足與準(zhǔn)確性波動。典型例子包括軟件工程、機(jī)器學(xué)習(xí)相關(guān)任務(wù)中的探索式問題。這類任務(wù)必須先建立結(jié)構(gòu),再做推導(dǎo),再做反證,再回溯修正。模型往往會在中途跳步,或者用看似合理的敘述替代真正的推理。

此外,模型容易給出方向正確但是缺乏可執(zhí)行細(xì)節(jié)的回復(fù)。比如在醫(yī)療場景下,需要的是可執(zhí)行的臨床要素,但模型容易泛泛而談,遺漏關(guān)鍵點(diǎn)。自然科學(xué)任務(wù)里存在類似的對實(shí)驗(yàn)條件的預(yù)期不足、對約束不夠細(xì)、機(jī)制鏈條理解淺。這種失敗在真實(shí)落地里殺傷力很大,因?yàn)樗雌饋怼昂軐Α保珱]有可實(shí)踐的信息量。

04 One Step Further —— 將把模型推進(jìn)到“可交付”的那一步

如果站在 2024 年的視角,會覺得 AI 還是一個“大玩具”。但站在 2026 年、OpenClaw 把 Agent 推到大眾面前之后,我們看到的是另一件事:AI 已經(jīng)能交付 50 萬美元級別的專業(yè)價值;接下來競爭的關(guān)鍵,是繼續(xù)提升這份價值,并且將這份價值變得更穩(wěn)定、更可復(fù)核、更可控,使智能的邊際提升能直接轉(zhuǎn)化為生產(chǎn)力和收入。

$OneMillion-Bench 的意義不在于“再做一個排行榜”,而是把“數(shù)字員工”的能力邊界量化出來:你今天和未來可以放心把哪些工作交給它?

關(guān)于 Humanlaya

Humanlaya 是一家成立于 2025 年的 AI 數(shù)據(jù)實(shí)驗(yàn)室,通過定義真實(shí)、高經(jīng)濟(jì)價值的可驗(yàn)證任務(wù),推動大模型能力邊界的拓展與經(jīng)濟(jì)價值的落地。

責(zé)編:hxq

〖免責(zé)申明〗本文僅代表作者個人觀點(diǎn),其圖片及內(nèi)容版權(quán)僅歸原所有者所有。如對該內(nèi)容主張權(quán)益請來函或郵件告之,本網(wǎng)將迅速采取措施,否則與之相關(guān)的糾紛本網(wǎng)不承擔(dān)任何責(zé)任。